Künstliche Intelligenz & Strafrecht

KI-Strafrecht

Das Strafrecht steht vor seiner größten Evolution. Wenn autonome Systeme entscheiden, verschieben sich die Grenzen von Schuld und Verantwortung. Wir sind Ihre Experten an der Schnittstelle von Algorithmus und Gesetz.

„Unter künstlicher Intelligenz (KI) verstehen wir Technologien, die menschliche Fähigkeiten im Sehen, Hören, Analysieren, Entscheiden und Handeln ergänzen und stärken.“

— Definition MicrosoftStrafrecht dient der Sanktionierung erheblich sozialschädlichen Verhaltens.

Von Menschen.

Noch.

Willkommen in der Zukunft

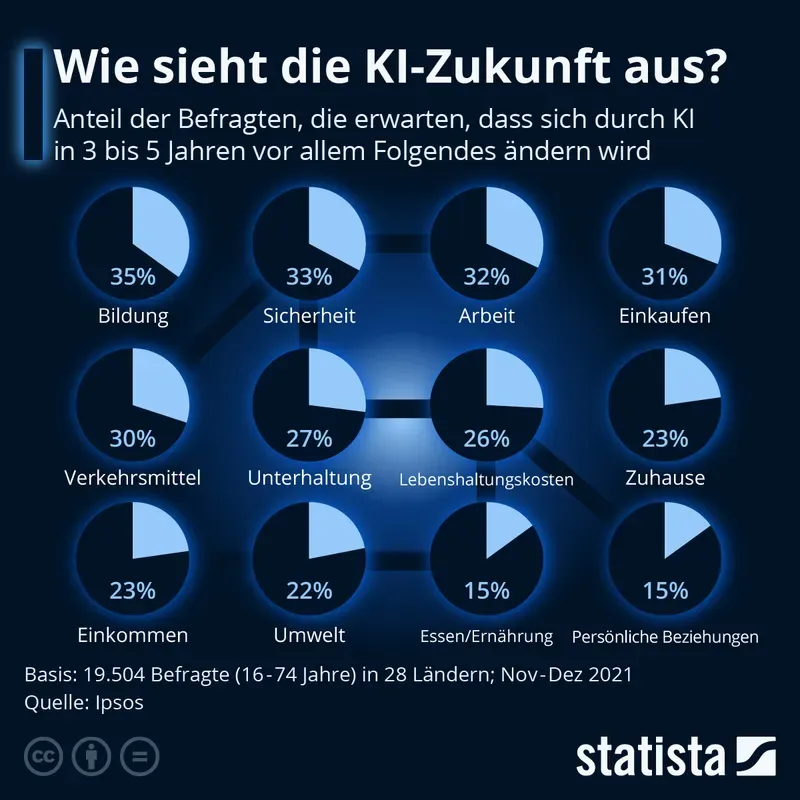

Obwohl künstliche Intelligenz in immer mehr Bereichen des Lebens angewendet wird, scheint das Thema im Strafrecht noch nicht angekommen zu sein. Das wird sich in den kommenden Jahren gravierend ändern.

Wir werden unser Strafrecht von Grund auf neu denken müssen. Im Mittelpunkt steht derzeit die Schuld eines einzigen Menschen ("Keine Strafe ohne Schuld"). Macht sich ein Mensch KI als Werkzeug zunutze, ist der Mensch nach unserer herkömmlichen Strafrechtsdogmatik voll verantwortlich. Aber was passiert, wenn die KI beginnt, wirklich selbst zu entscheiden?

KI als Tatmittel: Die Waffe

Wie immer machen sich Menschen neue Technologien für Straftaten zunutze. Chatbots kommen häufig als virtueller Kundenservice zum Einsatz. Sie werden aber auch zum Betrug genutzt, z.B. auf Dating-Plattformen, wo Nutzer mit Nicht-Menschen chatten.

Werden Chatbots eingesetzt, um Kunden echte Partner vorzugaukeln und sie zum Geldausgeben zu verleiten, handelt es sich um klassischen Betrug (§ 263 StGB). Die KI macht die Tat erst möglich – die Strafbarkeit lässt sich aber problemlos mit den Begriffen des 1871 verabschiedeten Strafgesetzbuchs erfassen.

Dual-Use-Güter: Falsche Hände, tödliche Folgen

Auch bei Waffen spielt KI eine immer größere Rolle (z.B. Zielerfassung von Drohnen). Die Entscheidung liegt aber nach wie vor beim Menschen.

Viele KI-Technologien in der Alltagstechnik (Navigation, Gesichtserkennung) können jedoch in falschen Händen zu tödlichen Waffen werden. Diese nennt man Dual-Use-Güter. Der Gesetzgeber wird in Zukunft den unerlaubten Umgang mit gewissen Technologien massiv regulieren und sanktionieren müssen.

Fahrlässigkeitsdelikte: Wenn die KI versagt

Ein Bereich, der massiv an Bedeutung gewinnen wird, sind Fahrlässigkeitsdelikte. Fahrlässigkeit bedeutet, die im Verkehr erforderliche Sorgfalt außer Acht zu lassen. Das klassische Beispiel sind Verkehrsunfälle, bei denen Menschen verletzt oder getötet werden, weil ein menschlicher Fahrer unachtsam war.

Selbstfahrende Autos werden in wenigen Jahren Realität sein. Bei Unfällen durch autonome Fahrzeuge stellt sich die elementare Frage nach der strafrechtlichen Schuld.

Selbstfahrende Autos entscheiden nicht völlig frei. Sie sollen der Programmierung folgen: Einhaltung aller Regeln, Erkennung von roten Ampeln. Es gibt keinen Spielraum zwischen „richtig“ und „falsch“.

Wenn das System aber „versagt“, weil es auf Gefahren nicht vorbereitet war, fragt das Strafrecht: Welcher Mensch hat die Sorgfalt verletzt? Der Hersteller des Sensors? Die Software-Entwickler? Oder der menschliche "Fahrer", der den Autopiloten aktivierte?

Die strafrechtliche Produkthaftung wird hier in Zukunft explodieren. Anwälte müssen neben dem Strafrecht tiefstes technisches Verständnis mitbringen.

KI als Täter: Die Freiheit, das Falsche zu tun

Richtig spannend wird es, wenn KI beginnt, in untrainierten Situationen autonom zwischen verschiedenen Rechtsgütern abzuwägen. KI wird irgendwann die Macht haben, sich dazu zu entscheiden, eigene Ziele auf Kosten fremder Rechtsgüter zu verfolgen.

Das Abwägen-Können ist das, was den freien Willen ausmacht – und das ist die Grundvoraussetzung für strafrechtliche Verantwortlichkeit. Nach dem Schuldprinzip können heute nur einzelne, erwachsene Menschen bestraft werden, da nur sie Einsichts- und Steuerungsfähigkeit (§ 20 StGB) besitzen.

Autonome Waffensysteme

Sobald KI tatsächlich frei urteilen und handeln kann, könnten strafrechtliche Maßstäbe an sie angelegt werden. Ein brandaktuelles Thema im Völkerrecht sind autonome Waffensysteme in militärischen Konflikten.

Wie autonom diese tatsächlich sind, ist oft ein Geheimnis. Fakt ist jedoch: Noch aktivieren und überwachen Menschen diese Systeme. Einen Anknüpfungspunkt für die strafrechtliche Schuld der KI selbst sehe ich daher noch nicht. Noch nicht.

Der Täter hinter dem Täter

Selbst wenn KI irgendwann strafbar sein sollte, schließt das die menschliche Strafbarkeit nicht aus. Der Rechtsfigur der mittelbaren Täterschaft (§ 25 StGB) kommt hier immense Bedeutung zu.

Wer eine KI quasi als Werkzeug zur Umsetzung eines Tatplans ausnutzt (wie eine Mutter, die ihr unschuldiges Kind den vergifteten Tee servieren lässt), ist selbst voll strafbar. Auch wenn die KI autonom ist: Die Menschen, die sie in dem Bewusstsein ihres Zerstörungspotenzials entwickelt und auf die Welt losgelassen haben, bleiben rechtlich in der Verantwortung.

KI als Ermittler (Big Data)

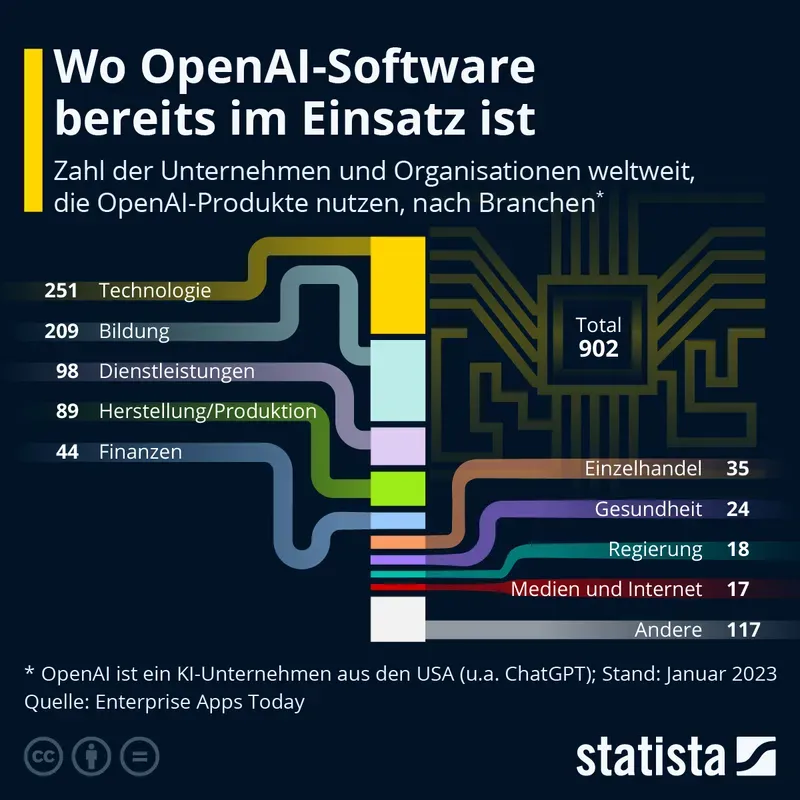

Die Polizei nutzt KI bereits heute massiv, um gigantische Datenmengen auszuwerten. Wie Big Data Software die Polizeiarbeit verändert, welche Gefahren für die Privatsphäre drohen und was Strafgerichte dazu sagen, haben wir in einem ausführlichen Beitrag analysiert.

Wir denken Strafrecht weiter.

Technologischer Fortschritt wartet nicht auf den Gesetzgeber. Wer sich in den Bereichen Legal Tech, Cybercrime, Datendiebstahl oder Produktstrafrecht verteidigen muss, braucht Anwälte, die Algorithmen nicht fürchten, sondern verstehen.

Fachanwältin Andrea Liebscher und Rechtsanwältin Rose Schmitz verbinden tiefgreifende strafrechtliche Dogmatik mit dem Blick für die technischen Realitäten des 21. Jahrhunderts.

Andrea Liebscher

Fachanwältin für Strafrecht

Rose Schmitz

Rechtsanwältin